AI算力价格战打响:Google的TPU革命如何撼动Nvidia的芯片帝国

一场围绕AI算力定价权的暗战正在硅谷上演,科技巨头们的芯片军备竞赛已进入新阶段。

一场围绕AI算力定价权的暗战正在硅谷上演,科技巨头们的芯片军备竞赛已进入新阶段。

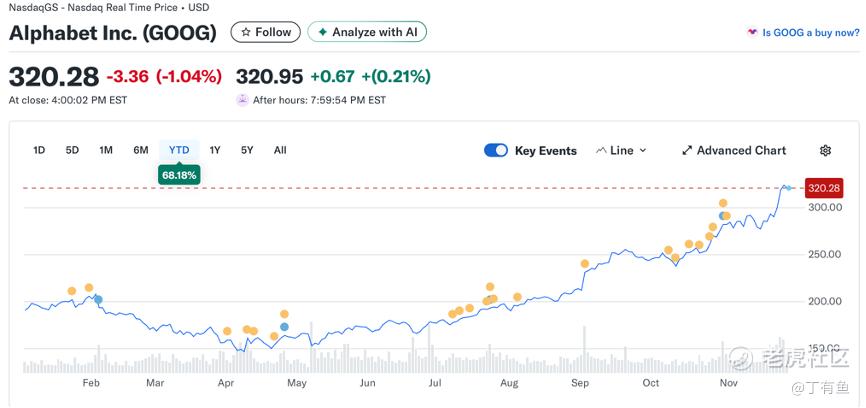

过去一个月,全球科技股版图悄然生变。Google母公司Alphabet市值历史性突破4万亿美元大关,而同期Nvidia却在创下历史新高后意外回落,市值蒸发超过3000亿美元。

表面看是资本市场的情绪波动,实则揭示了AI基础设施领域正在发生的深刻变革——从GPU一家独大到多元算力生态的转变已经拉开序幕。

01 突袭:Google的TPU组合拳为何让市场震动

这场变革的导火索源自一则重磅行业消息。据《The Information》和《Bloomberg》等权威媒体报道,Meta正在与Google深入洽谈一笔价值数十亿美元的TPU采购协议。

消息人士透露,Meta计划在2026年前通过Google Cloud大规模使用TPU芯片,后续甚至考虑将TPU直接部署到自家数据中心。这一动向立即在资本市场引发连锁反应。

市场为何如此敏感?Meta作为全球AI投入最大的三巨头之一(仅次于OpenAI和Google),其技术路线选择具有风向标意义。当这样的顶级玩家开始认真考虑TPU方案,Nvidia在AI算力市场的定价权垄断首次出现了实质性裂缝。

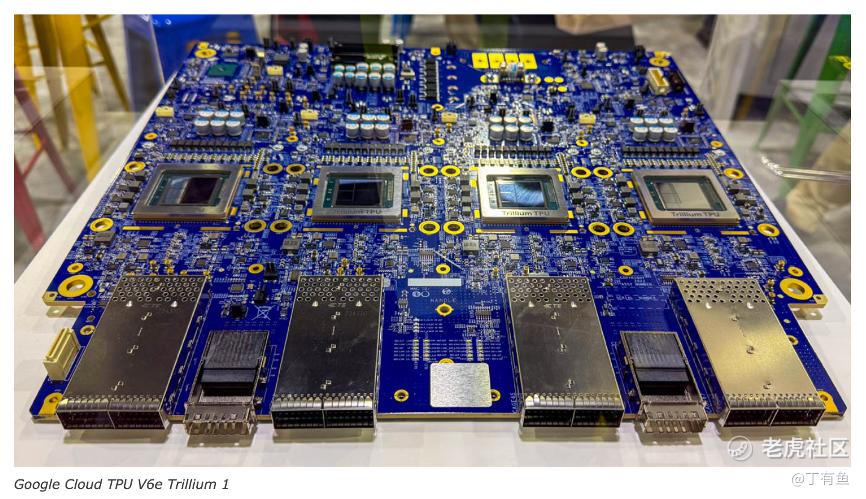

Google此次的杀手锏是新一代TPU架构:TPU v6(代号Trillium)和TPU v7(代号Ironwood)。根据Google官方技术文档和AI峰会披露的数据,这两款芯片在性能上实现了跨越式提升。

TPU v6专注于训练场景,相比前代性能提升约4-5倍;而TPU v7则是为推理场景深度定制,峰值算力较v5p提升近10倍。更关键的是成本效益——Google宣称在训练效率上提升3倍,推理效率提升5倍。

推理成本正是科技巨头们的“心头肉”。随着大模型从训练转向大规模应用,推理成本直接决定了AI业务的盈利能力。这就像从造车阶段进入用车阶段,油耗(推理成本) 成了最关键的经济指标。

AI初创公司Anthropic已经用实际行动投了票,在2023-2024年间将Claude模型的训练全部迁移到Google的TPU集群。现在Meta的跟进,进一步印证了这一趋势。

02 护城河:Nvidia的CUDA生态面临真正考验

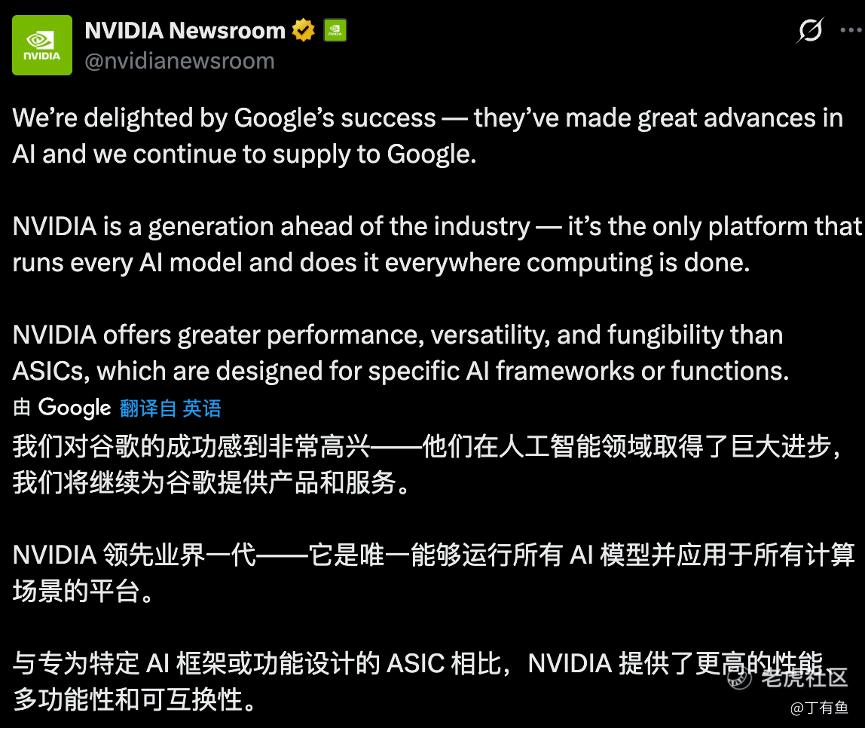

面对Google的攻势,Nvidia的反应相当迅速。公司在官方社交账号发布了一份罕见的声明,强调GPU仍然是“最通用的算力平台”,并指出Google自身在内部依然大量使用Nvidia GPU。

这份声明的措辞耐人寻味——没有往日的自信满满,反而带着几分“澄清”和“维稳”的意味。Nvidia创始人黄仁勋素来不屑于评论竞争对手,这次亲自下场回应,本身就说明TPU的威胁不容小觑。

要理解Nvidia的处境,关键在于区分AI的两种核心算力需求:训练与推理。

训练如同教育一个天才儿童,需要因材施教、不断调整教学方法,这就要求硬件具备极高的灵活性。Nvidia的GPU配以CUDA生态,正好满足这种需求。经过十余年积累,CUDA已经绑定了全球绝大多数AI开发者,形成了难以逾越的生态护城河。

而推理更像是让这个受过教育的天才批量完成特定任务,这时效率和经济性就成为了首要考量。TPU v7的定位恰恰击中了这个痛点——通过专用架构优化,大幅降低每次推理的电力成本和硬件开销。

高盛最新研报指出,在大模型推理场景中,专用芯片相比通用GPU有望降低40-60% 的单次推理成本。这个数字对于每天处理数十亿次查询的科技巨头来说,意味着每年节省数亿美元计的开支。

03 变局:AI算力市场迎来“三国演义”

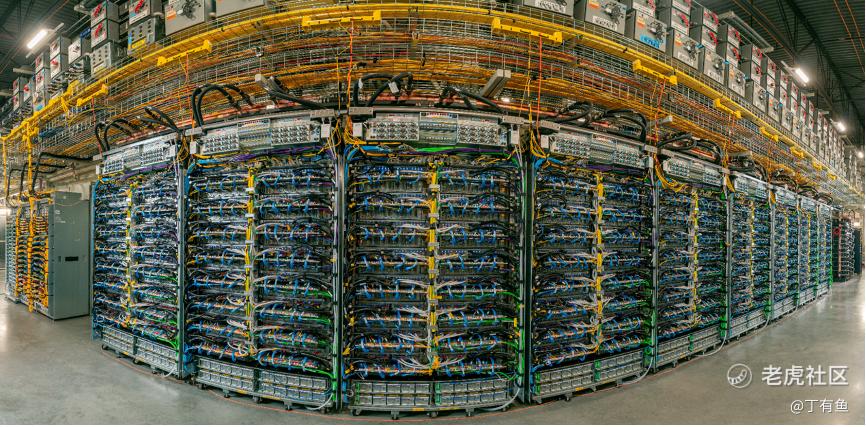

Google这轮攻势的精妙之处在于,它不只是卖芯片,而是提供了一整套端到端的算力解决方案——Google将其命名为“AI Hypercomputer”架构。

这个架构包含自研TPU芯片、液冷数据中心、Jupiter网络体系和TPU Pod集群管理。本质上,Google把算力做成了类似水电煤的公共事业服务,这与Nvidia传统卖硬件的商业模式形成鲜明对比。

摩根士丹利分析师在最近报告中形容:“Nvidia像是在卖顶级发动机,而Google直接提供完整的交通运输服务。对于很多企业来说,他们不需要自己造车,只需要安全高效地到达目的地。”

这种模式特别受到中大型企业的欢迎。根据Synergy Research Group的数据,2024年第一季度,企业在云AI服务上的支出同比增长187%,远超在自有基础设施上的AI投资增速。

市场格局正在从“一超多强”转向“三足鼎立”:

- Nvidia继续主导训练市场,凭借CUDA生态和硬件性能维持技术领先

- Google通过TPU和云服务组合,在推理市场建立成本优势

- AWS和Azure也在快速推进自研芯片,不甘沦为单纯的渠道商

这场竞争的核心不再是单纯的性能比拼,而是商业模式和生态体系的对抗。

04 未来:算力民主化与价格战的连锁反应

这场AI算力价格战的深远影响正在逐步显现。行业专家预测,未来12-18个月内,大模型推理成本有望下降50-70%,这将极大加速AI技术的普及和应用创新。

“我们正在见证AI算力的民主化进程,”一位硅谷风投合伙人表示,“就像当年AWS让初创企业不再需要自建机房一样,现在Google的TPU服务正在让更多公司能够负担得起大模型应用。”

这种变化已经在资本市场上有所体现。除了Google和Nvidia的此消彼长,整个芯片板块也在重新定价。AMD、Intel等传统芯片巨头,以及Cerebras、SambaNova等AI芯片初创公司都获得了更多关注。

对于终端用户而言,这场竞争最终将带来实实在在的好处。想象一下,不久的将来,智能助手可以7x24小时待命而不用担心天价账单,AI绘图工具可以无限次使用而只需支付象征性费用,企业能够以更低成本部署定制化AI应用。

这场算力战争没有绝对的赢家输家,而是标志着一个更加成熟、多元的AI基础设施时代正在到来。训练仍然是GPU的天下,推理将成为各种专用芯片的竞技场,而调度和管理则催生了新的软件定义算力层。

当算力真正成为像电力一样按需取用的公共资源时,整个AI产业的重心将从“硬”到“软”,从“基础设施建设”转向“应用场景创新”。这才是Google与Nvidia之争背后,真正值得期待的未来图景。