谷歌TPU“亮剑”,英伟达的“铁王座”开始摇晃?

2025年的AI算力战场,硝烟味从未如此浓烈。长久以来,英伟达(NVIDIA)凭借其GPU和CUDA生态,几乎以一己之力定义了全球AI基础设施的格局,其高达75%的毛利率也被视为难以撼动的“护城河”。然而,一场由昔日最大客户发起的“釜底抽薪”式进攻,正在让这场独角戏变为双雄对决。谷歌,这个搜索巨头,正将其秘密武器TPU(张量处理单元)全面推向商用市场,目标直指英伟达的定价权与市场主导地位。

2025年的AI算力战场,硝烟味从未如此浓烈。长久以来,英伟达(NVIDIA)凭借其GPU和CUDA生态,几乎以一己之力定义了全球AI基础设施的格局,其高达75%的毛利率也被视为难以撼动的“护城河”。然而,一场由昔日最大客户发起的“釜底抽薪”式进攻,正在让这场独角戏变为双雄对决。谷歌,这个搜索巨头,正将其秘密武器TPU(张量处理单元)全面推向商用市场,目标直指英伟达的定价权与市场主导地位。

从“核武库”到“军火商”:谷歌的战略大转向

过去,谷歌的TPU如同其搜索算法排名一样,是高度保密、仅供自用的“镇宅之宝”。但商业世界的逻辑在于,没有永远的朋友,只有永恒的利益。当谷歌发现,自己庞大的AI研发需求(从搜索到Gemini大模型)与对外提供云服务(Google Cloud)的算力需求,可以汇聚成一股挑战现有秩序的力量时,策略的转变便顺理成章。

最新的供应链与市场分析显示,谷歌已从“云服务提供商”悄然变身为“高性能算力系统供应商”。最重磅的信号来自AI明星公司Anthropic。据报道,Anthropic计划部署超过100万颗最新的TPU v7(代号“Ironwood”)芯片。这笔交易的构成极具深意:约40万颗由芯片制造商博通(Broadcom)直接出售给Anthropic,价值约百亿美元;其余60万颗则通过谷歌云以租赁方式提供,对应着长达数年的、价值数百亿美元的履约义务。

这种“混合销售”模式堪称精妙。它既像传统芯片销售一样直接获取巨额收入,又通过云租赁锁定了客户的长期使用和生态绑定。这不仅仅是卖芯片,更是输出一整套包括芯片、网络、软件和金融方案在内的“算力系统”。除了Anthropic,包括Meta、xAI在内的多家头部AI实验室都被证实正在评估或测试TPU集群。市场的天平,开始出现了微妙的倾斜。

“成本屠夫”的金融工程:TCO成为终极杀器

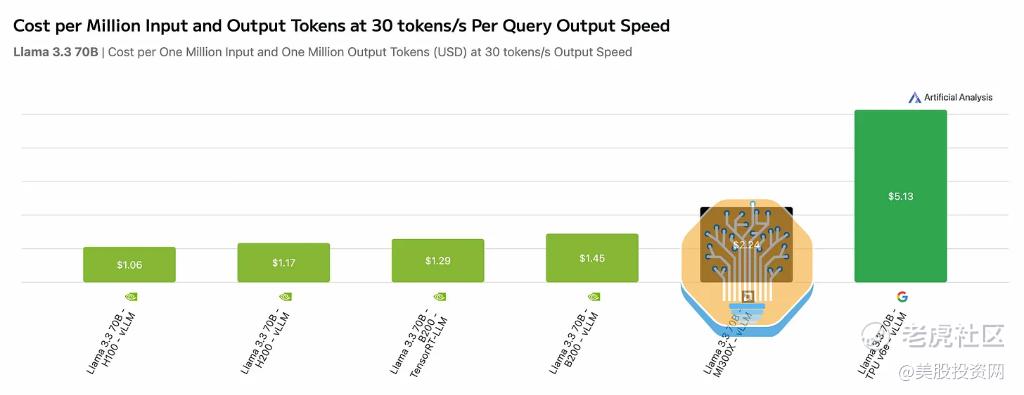

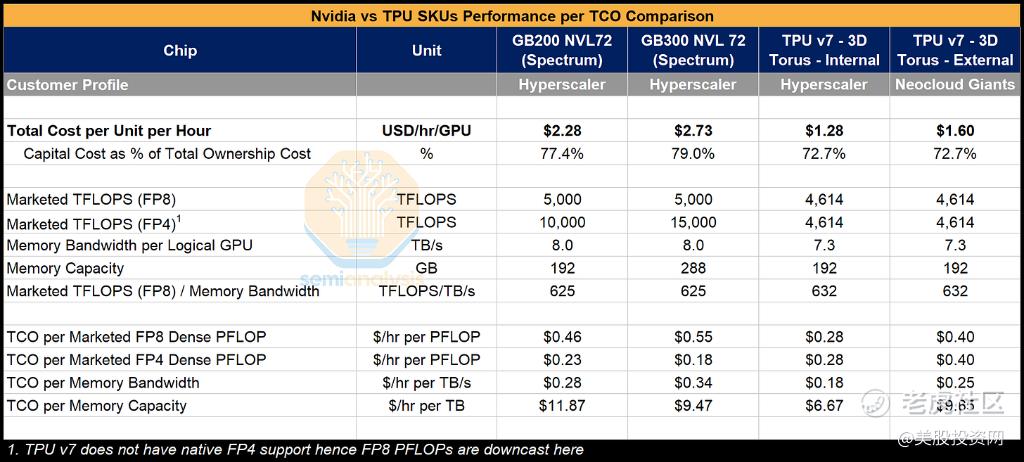

对于动辄需要投入数十亿美元训练大模型的AI公司而言,性能是入场券,但总拥有成本(TCO) 才是决定生死的生命线。英伟达的GPU强大,但价格也“高贵”。谷歌的进攻,恰恰抓住了这个最痛的痛点。

根据行业分析机构SemiAnalysis的测算,基于TPU v7构建的服务器,其TCO比英伟达最新的GB200超级芯片系统低约44%。即使客户选择通过谷歌云租赁而非直接购买,TCO仍然能比直接采购英伟达方案低30%左右。这可不是靠打价格战、牺牲利润换来的,而是谷歌凭借其综合实力玩出的一套“金融与系统工程组合拳”。

这套拳法的核心在于“超级云厂商兜底”。想象一下:一个AI初创公司想自建算力中心,它面临芯片4-5年就可能过时的技术风险、长达15年的数据中心租约,以及高昂且艰难的融资门槛。谷歌的解决方案是:由它来提供“信用担保”,承诺为算力设施兜底未来的租金,从而说服数据中心和电力供应商以更优条件合作。这就好比一个信用极好的人为你租房做担保,房东立刻放心,租金也能商量。谷歌借此构建了一个独立于传统英伟达供应链之外的低成本基础设施生态,将金融风险从客户肩上移走,化为了自己的竞争优势。

更有趣的是,这种成本压力已经产生了立竿见影的“鲶鱼效应”。有市场消息称,OpenAI仅凭“考虑采购TPU”的谈判策略,就成功让其计划中的英伟达计算集群获得了约30%的折扣。当客户手中有了第二个选择,垄断者的定价权就不再是铁板一块。

系统级对决:不仅是芯片跑分,更是整体效率

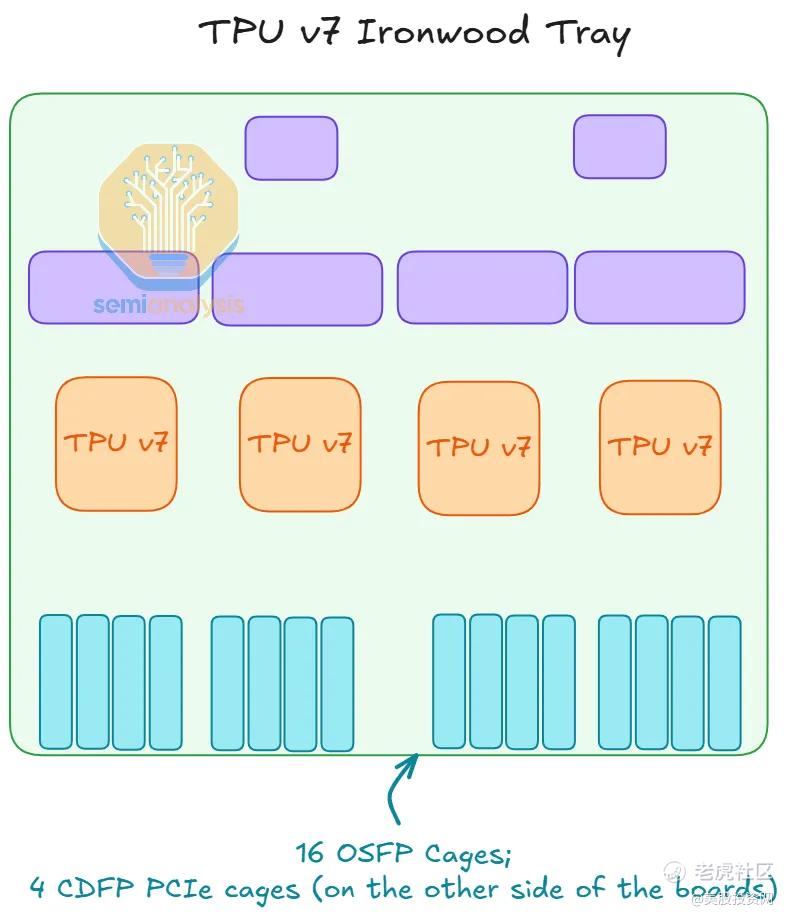

如果认为这只是一场芯片间的“拳击赛”,那就太小看谷歌了。这更像是一场“海陆空协同作战”。单看纸面参数,TPU v7的峰值算力或许与英伟达Blackwell芯片各有千秋,但谷歌真正的王牌在于其系统级工程能力。

其秘密武器之一是名为 ICI(光互连) 的内部连接系统。与英伟达主要依赖的NVLink技术不同,谷歌的ICI系统采用自研的光交换机(OCS)和3D Torus网络拓扑。这意味着什么?一个TPU Pod可以轻松扩展至超过9000颗芯片协同工作,远超英伟达系统常见的64或72卡规模。而且,光信号传输无需进行耗能且慢速的“光电-电光”转换,延迟和功耗大幅降低。网络还能在毫秒级动态重构,自动绕过故障节点,保证了超大规模集群的稳定性和利用率。

结果就是,谷歌系统的模型算力利用率(MFU) 往往更高。也就是说,用户花钱买的理论算力,在谷歌的系统中能有更大比例被实际用于模型训练,而不是浪费在等待或通信上。Gemini系列大模型和Anthropic最新的Claude模型都在TPU上完成了核心训练,这本身就是对其系统能力最有力的背书——毕竟,没有谁会用不可靠的工具去打造自己最核心的产品。

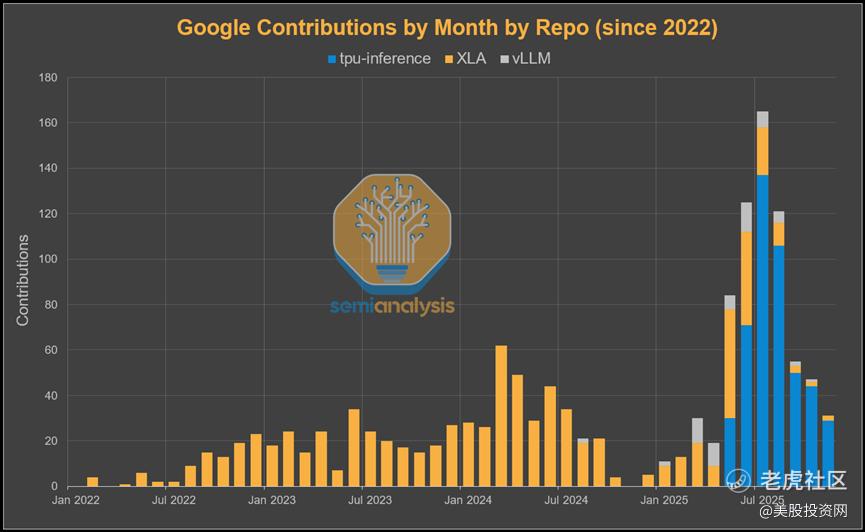

推倒“巴别塔”:谷歌终于拥抱开源生态

长期以来,开发者不愿投入TPU怀抱的最大障碍并非硬件,而是软件。英伟达用超过十五年时间构建的CUDA软件生态,是其最深的护城河。全球AI开发者几乎都生活在PyTorch或TensorFlow + CUDA的世界里。而谷歌过去力推自己的JAX框架,虽然先进但曲高和寡,像是一座技术“巴别塔”,将大量开发者拒之门外。

然而,在巨大的商业前景面前,任何技术坚持都可以改变。谷歌正在发起一场彻底的“生态投降”式进攻。其软件团队的KPI已经从服务内部转向全面拥抱开源社区。最新的动作是全力支持 PyTorch Native 在TPU上高效运行,让开发者无需改变熟悉的编程习惯(从动态图模式)就能迁移到TPU平台。同时,谷歌也在大力投资vLLM等热门开源推理框架,确保从训练到部署的全链路体验。

简单说,谷歌正在用“兼容并包”的策略,主动填平CUDA的护城河。它不再要求开发者“说谷歌的语言”,而是主动去“说开发者的语言”。当软件障碍被移除,硬件性价比的优势就会赤裸裸地摆在客户面前。

王座争夺战:一场刚刚开始的马拉松

面对谷歌的全方位进击,英伟达显然已经感受到了压力。其财务团队近期罕见地发布长篇解释,回应市场对其“循环经济”商业模式的质疑,这被外界解读为一种防御姿态。英伟达的护城河依然深广:无与伦比的游戏与专业可视化市场、庞大的开发者社区、以及即将到来的下一代Rubin架构。它远未到失败的时刻。

但2025年无疑是一个转折点。AI芯片市场第一次出现了具有实质意义的“第二选择”。竞争带来的好处是显而易见的:更快的技术创新、更低的企业成本、更丰富的市场选项。对于整个AI行业而言,算力垄断的坚冰被打破,可能意味着应用创新的成本门槛大幅降低,从而加速AI技术向千行百业的渗透。

这场硅谷“王座争夺战”的终局远未到来。谷歌的TPU v8与英伟达的Rubin架构已在研发路上,下一轮正面碰撞正在酝酿。可以确定的是,那个由单一巨头完全掌控游戏规则的时代,已经过去了。未来的AI算力市场,将是一个更加多元、竞争也更加激烈的江湖。对于投资者和行业观察者来说,这出大戏,精彩章节才刚刚开始。